GitHub Copilot 数据政策更新分析(On April 24 we'll start using GitHub Copilot interaction data for AI model training)

GitHub Copilot 数据政策更新分析

📋 核心信息摘要

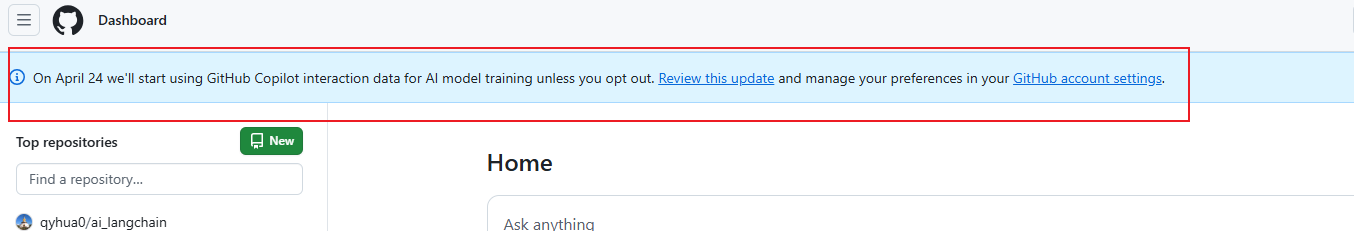

"On April 24 we'll start using GitHub Copilot interaction data for AI model training unless you opt out."

如下图:

这条通知意味着:从2026年4月24日起,GitHub 将默认使用 Copilot Free/Pro/Pro+ 用户的交互数据训练其 AI 模型,除非用户主动选择退出(opt-out)[[12]]。

🔍 政策变化详解

📊 受影响用户范围

| 用户类型 | 是否受影响 | 说明 |

|---|---|---|

| Copilot Free | ✅ 是 | 默认参与训练,需手动退出 |

| Copilot Pro/Pro+ | ✅ 是 | 默认参与训练,需手动退出 |

| Copilot Business | ❌ 否 | 企业版不受此政策影响 |

| Copilot Enterprise | ❌ 否 | 企业版不受此政策影响 |

🗂️ 可能被用于训练的数据类型

如果未选择退出,以下交互数据可能被用于模型训练[[2]]:

- ✅ 你接受或修改过的代码建议/输出

- ✅ 发送给 Copilot 的输入(包括提示词、代码片段)

- ✅ 光标周围的代码上下文

- ✅ 你编写的注释和文档

- ✅ 文件名、仓库结构、导航模式

- ✅ 与 Copilot 功能的交互行为(聊天、行内建议等)

- ✅ 对建议的反馈(👍/👎评分)

🔒 明确不会被使用的数据

- 私有仓库中"静态存储"的源代码(但使用时产生的交互数据可能涉及)[[12]]

- Issues、Discussions 中的内容

- 已选择退出的用户数据

- Business/Enterprise 计划用户的数据

⚠️ 关键风险点

- "默认同意"机制:如果不主动操作,4月24日后你的数据将自动被用于训练[[30]]

- 私有代码边界模糊:虽然"存储状态"的私有代码不会被使用,但你在私有仓库中使用 Copilot 时产生的交互数据(如提示词、接收的建议)可能被纳入训练[[5]]

- 数据共享范围:训练数据可能与 GitHub 关联公司(包括 Microsoft)共享,但不会提供给第三方 AI 模型提供商[[12]]

🛠️ 如何退出(Opt-Out)操作指南

方法一:直接访问设置页面

- 登录 GitHub,访问:

https://github.com/settings/copilot[[6]] - 向下滚动找到 "Privacy"(隐私)部分

- 找到选项:

Allow GitHub to use my data for AI model training - 将其设置为 "Disabled" 并保存

方法二:通过个人设置入口

- 点击 GitHub 页面右上角头像 → Settings

- 左侧菜单选择 Copilot → Features

- 在 Privacy 区域关闭数据共享选项[[37]]

💡 提示:如果你之前已选择退出"允许 GitHub 收集数据用于产品改进",该偏好设置会被保留,无需重复操作[[40]]。

💡 建议与最佳实践

对个人开发者

- 🔎 立即检查设置:确认当前数据共享状态,避免因遗忘而被动参与

- 🧭 评估使用场景:如果经常处理敏感/商业代码,建议关闭数据共享

- 🔄 定期复查:政策可能继续调整,建议每季度检查一次隐私设置

对团队/企业管理员

- 📢 内部通知:告知团队成员此项政策变化及操作方式

- 🏢 考虑升级计划:如需更强的数据保护,可评估 Business/Enterprise 方案

- 📋 制定使用规范:明确哪些代码场景允许使用 Copilot

🤔 为什么会有这个变化?

GitHub 官方解释:

过去一年使用微软员工交互数据训练后,代码建议的接受率在多种语言中均有提升。他们希望通过更广泛的真实开发场景数据,进一步提升模型对多样化用例的理解能力[[12]]。

这反映了当前 AI 行业的普遍做法:真实用户交互数据是提升模型效果的关键资源。但这也引发了关于用户知情权、数据主权和商业伦理的持续讨论[[26]]。

📌 一句话总结

如果你使用 Copilot Free/Pro/Pro+ 且不希望自己的代码交互数据被用于训练,请在 2026 年 4 月 24 日前手动关闭设置中的"允许使用我的数据进行 AI 训练"选项。