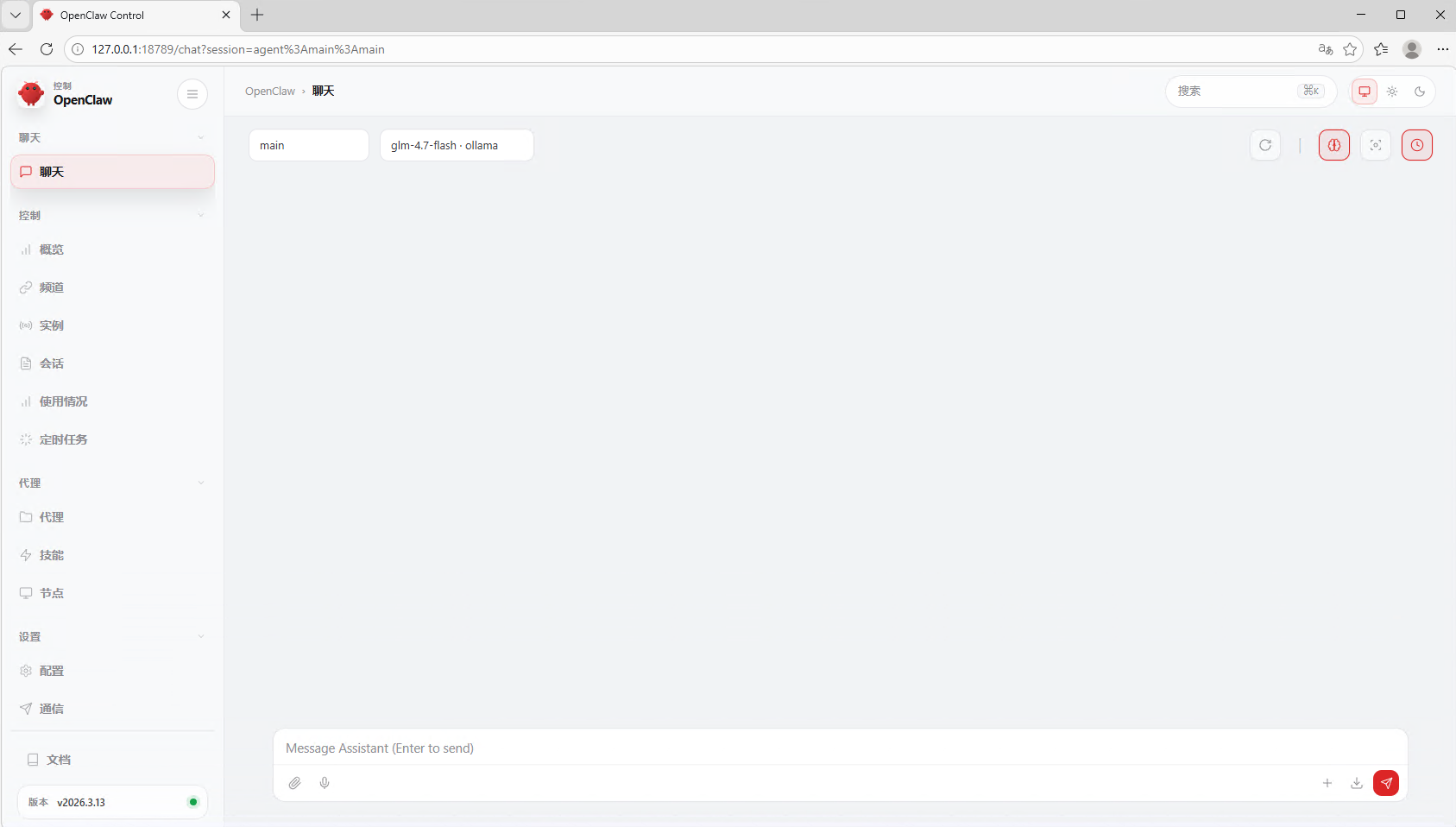

10分钟跑通 OpenClaw:本地部署 + 模型配置完整教程(普通用户版)

10分钟跑通 OpenClaw:本地部署 + 模型配置完整教程(普通用户版)

很多人看完 OpenClaw 的介绍后,可能会觉得“怎么跑不起来?”

这篇文章的目标是:

在最短的时间内,使用最简单的方法跑通 OpenClaw。

一、环境准备(3分钟)

1)基础要求

首先,确保你有以下基础工具:

- 操作系统:Windows / macOS / Linux(支持多平台)

- Python 3.10 以上版本

- Git(推荐安装)2)安装 OpenClaw

打开终端(命令行)并输入以下命令来安装 OpenClaw:

pip install openclaw这一步会自动下载并安装所需的依赖项。如果没有安装 Python,可以去 Python 官网 下载。

二、模型配置(关键步骤)

OpenClaw 本身不带模型,你需要配置模型(如 Ollama 或者 OpenAI API)。这里我们以使用 Ollama 本地模型 为例,步骤非常简单。

1)安装 Ollama

如果你还没有安装 Ollama,可以去 Ollama 官网 下载适合你系统的版本,安装后启动它。

2)拉取模型

打开命令行,运行以下命令来下载需要的模型:

ollama pull qwen3:32b3)启动 Ollama 服务

模型下载完成后,启动 Ollama 服务:

ollama serve服务启动后,它会监听 11434 端口,这时模型已经准备好,可以在本地使用了。

4)配置 OpenClaw

接下来,你需要配置 OpenClaw 使用 Ollama 模型。找到 OpenClaw 配置文件,或者在代码中创建一个名为 config.toml 的文件,内容如下:

[llm]

api_type = "ollama"

model = "qwen3:32b"

base_url = "http://localhost:11434/v1"

api_key = "ollama"注意:如果你使用的是 OpenAI 模型或其他服务,只需要修改base_url和api_key即可。

三、创建第一个 Agent(核心操作)

现在,我们来创建第一个 Agent,步骤非常简单。

1)创建 Identity(角色定义)

在项目根目录下新建一个 IDENTITY.md 文件,定义 Agent 的角色和行为。示例内容:

你是一个专业的AI助手,回答要简洁、准确、有条理。2)运行 Agent

在命令行中,进入 OpenClaw 的安装目录,运行以下命令启动 Agent:

python main.py3)输入测试

现在你可以在终端中输入一些测试问题,看看 Agent 的反应:

请解释什么是AI Agent如果一切正常,你将看到类似如下的响应:

AI Agent 是一种能自主决策并执行任务的人工智能系统...四、进阶:加入 Tool(可选)

如果你想让 Agent 更智能,可以添加外部工具来增强它的能力。

例如,我们可以添加一个简单的 时间查询工具:

def get_time():

return "当前时间是:2026-03-30"然后,在配置文件中注册该工具,接着执行命令来调用它。

五、常见问题及解决方法(必看)

尽管我们已经做了很多简化,但仍然可能遇到一些常见问题。以下是解决方案。

❌ 问题1:无法连接到模型

错误信息:Connection refused

解决方法:

- 确保 Ollama 已启动并且没有错误。

- 检查

base_url配置是否正确。

❌ 问题2:模型没有下载

错误信息:model not found

解决方法:

运行命令:

ollama list确保模型已正确下载。如果没有,重新拉取模型。

❌ 问题3:没有返回任何结果

解决方法:

- 检查

IDENTITY.md是否有内容。 - 确保模型正常启动并能够正常响应。

六、总结

通过这篇文章,你已经掌握了如何:

- 安装 OpenClaw 并配置模型

- 创建并运行第一个 Agent

- 解决一些常见的配置问题