AMD Strix Halo 96GB 显存实战:Ollama 跑 Qwen3.5-122B-A10B MoE 的完整踩坑指南与最佳实践

AMD Strix Halo 96GB 统一显存实战:Ollama + OpenClaw 踩坑全记录与最终成功方案(LM Studio 实现 70GB+ 显存)

基于真实 Strix Halo 配置实战

日期:2026 年 3 月

AMD Ryzen AI MAX+ 395(Strix Halo / Radeon 8060S gfx1151)配备 96GB 统一显存,理论上是最适合本地大模型的 APU 之一。搭配 Qwen3.5-122B-A10B(MoE,总参数 122B,激活仅 ~10B,Q4_K_M 量化 ≈81GB),配合 OpenClaw 本地 Agent 框架,本该实现云端级智能体验。

然而,从 Windows 原生 Ollama 迁移到 WSL2 Ubuntu 的过程中,却反复遭遇“model requires more system memory (80.2 GiB) than is available (29.9 GiB)”的错误,日志显示 total_vram="0 B",模型始终 fallback 到 CPU。本文完整梳理整个调试过程,深度解析问题根源,并给出最终成功路径。

1. 硬件配置与目标

- APU:AMD Ryzen AI MAX+ 395(16 核 32 线程,最高 4.07 GHz)

- iGPU:Radeon 8060S(gfx1151),支持最高 96GB 可变图形内存(统一内存架构 UMA)

- 系统:Windows 11 + WSL2 Ubuntu

- 目标:Ollama 加载

qwen3.5:122b-a10b,配合 OpenClaw 实现多步 Agent 任务,充分利用 96GB 统一显存

2. 问题复现全过程

起初在 Windows 原生 Ollama 中拉取模型成功,随后通过文件复制 + sha256 前缀修复的方式迁移到 WSL2。配置 OLLAMA_VULKAN=1、OLLAMA_FLASH_ATTENTION=1、HSA_OVERRIDE_GFX_VERSION=11.0.1 等环境变量,并将 .wslconfig 内存上限提升至 100GB。

多次重启 Ollama 服务后,ollama list 能看到模型,但运行时始终报内存不足。关键日志特征为:

inference compute id=cpu total="31.0 GiB"total_vram="0 B"discovering available GPUs...后直接 fallback 到 CPU backendmodel request too large for system

即使调整 override.conf,GPU 始终无法被正确识别。

3. 核心问题解析:ROCm / Vulkan 在 WSL2 的统一显存限制

Strix Halo 的最大优势——96GB 统一显存,在 WSL2 环境下却成了最大障碍:

- WSL2 虚拟化层无法完整映射 Windows 侧的可变图形内存,导致 ROCm 把可用内存池严格限制在

.wslconfig设置的系统 RAM 大小(约 30GB)。 - Vulkan 后端虽然启用,但

discovering available GPUs阶段失败,total_vram始终为 0。 - 即使设置

HSA_OVERRIDE_GFX_VERSION,也仅出现警告而无法激活 gfx1151 设备。

这正是 Strix Halo + WSL2 大模型部署的典型痛点:统一显存被虚拟化层“切断”,大模型加载直接失败。

4. 最终成功方案:切换至 LM Studio(Windows 原生)

经过多次尝试,Windows 原生 LM Studio 是当前 Strix Halo 上最稳定、高效的方案。它对统一显存的识别远优于 WSL2 + Ollama,能直接利用 Radeon 8060S 的 96GB 显存。

操作步骤(简洁版):

- 下载最新版 LM Studio(官网或 GitHub)。

- 导入已有的

qwen3.5:122b-a10bGGUF 文件(或直接搜索下载)。 - 在模型设置中选择 Vulkan 或 AMD ROCm 后端,开启 Flash Attention。

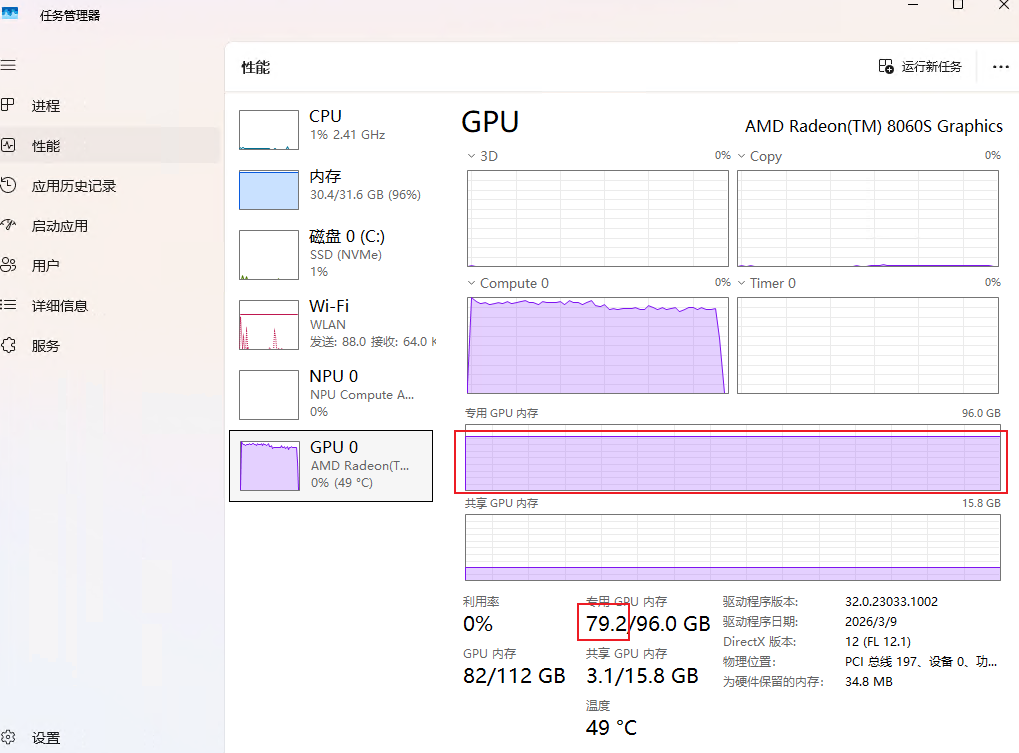

- 加载模型后,立即观察 Windows 任务管理器 → GPU 0(Radeon 8060S)。

如图所示,模型加载后 Dedicated GPU memory + Shared GPU memory 轻松突破 70GB,CPU 占用极低,推理流畅。OpenClaw 可通过 LM Studio 的本地服务器(localhost:1234 或自定义端口)无缝调用,实现完整的本地 Agent 工作流。

5. 总结与经验教训

- Strix Halo 硬件潜力巨大,但 WSL2 + ROCm/Vulkan 的统一显存支持仍不成熟。

- 优先推荐 Windows 原生工具(LM Studio > Ollama Windows 版),能稳定利用 70GB+ 显存。

- 对于 OpenClaw 用户,LM Studio 作为后端是目前最务实的组合。

- 如果追求极致性能,可考虑原生 Ubuntu 双系统,但日常使用 Windows + LM Studio 已足够强大。

一句话结论:

别在 WSL2 里死磕 122B 模型了 —— 直接上 LM Studio,96GB 统一显存终于能真正“飞起来”!

欢迎同配置的朋友在评论区分享你的 LM Studio 实测数据,一起优化本地大模型体验。🚀