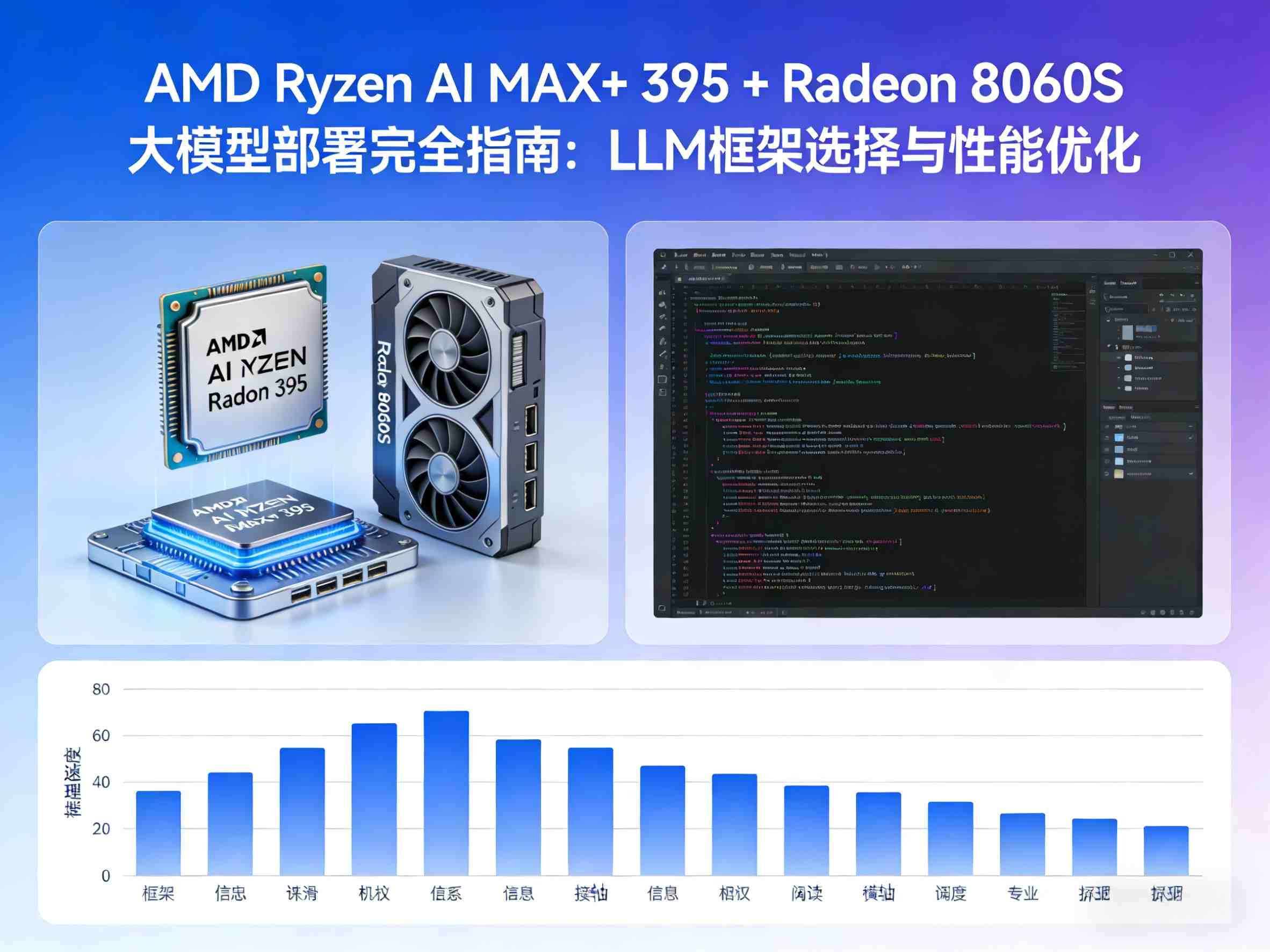

AMD Ryzen AI MAX+ 395 + Radeon 8060S 大模型部署完全指南:LLM框架选择与性能优化

AMD Ryzen AI MAX+ 395 + Radeon 8060S 大模型部署完全指南:LLM框架选择与性能优化

摘要:本文深入解析AMD Ryzen AI MAX+ 395处理器搭配Radeon 8060S集成显卡的大模型部署方案,对比Vulkan、ROCm、NPU三种推理后端的性能差异,提供LM Studio、llama.cpp、vLLM等主流框架的实战部署教程,帮助开发者充分发挥128GB统一内存优势,实现70B+参数模型的本地化推理。

关键词:AMD Ryzen AI MAX+ 395, Radeon 8060S, 大模型部署, LLM推理, ROCm, Vulkan, llama.cpp, LM Studio

1. 引言:Strix Halo架构的AI革命

1.1 移动工作站的性能新标杆

2025年发布的AMD Ryzen AI MAX+ 395处理器(代号Strix Halo)标志着AMD在移动AI计算领域的重大突破。这款处理器集成了:

- 16核Zen 5 CPU:提供强大的通用计算能力

- Radeon 8060S GPU(40 CU RDNA 3.5架构):图形与AI推理双引擎

- XDNA 2 NPU:50+ TOPS专用AI加速器

- 128GB LPDDR5X统一内存:突破传统显存限制

这一配置使得在移动工作站上运行70B+参数大语言模型成为可能,为本地化AI应用开辟了新纪元。

1.2 本文目标读者

- 拥有AMD Ryzen AI MAX+ 395设备的开发者和AI爱好者

- 需要在本地部署大模型的隐私敏感型应用开发者

- 追求极致性能优化的AI工程师

- 希望了解AMD ROCm生态的技术决策者

2. 硬件架构深度解析

2.1 三位一体的AI计算单元

Ryzen AI MAX+ 395采用异构计算架构,三个计算单元各司其职:

graph TD

A[AMD Ryzen AI MAX+ 395] --> B[CPU: 16核 Zen 5]

A --> C[GPU: Radeon 8060S<br/>40 CU RDNA 3.5]

A --> D[NPU: XDNA 2<br/>50+ TOPS]

B --> E[通用计算<br/>任务调度]

C --> F[高吞吐推理<br/>图形渲染]

D --> G[低功耗持续推理<br/>AI协处理]

E --> H[128GB LPDDR5X<br/>统一内存池]

F --> H

G --> H2.2 统一内存架构的优势

传统GPU受限于独立显存容量(通常8-24GB),而Strix Halo的统一内存架构允许GPU直接访问系统内存,理论上可使用全部128GB内存。这意味着:

| 模型规模 | 量化精度 | 内存需求 | 可运行性 |

|---|---|---|---|

| 7B | Q4_K_M | ~5GB | ✅ 轻松运行 |

| 13B | Q4_K_M | ~9GB | ✅ 轻松运行 |

| 30B | Q4_K_M | ~20GB | ✅ 流畅运行 |

| 70B | Q4_K_M | ~40GB | ✅ 完全可行 |

| 120B | Q4_K_M | ~70GB | ✅ 仍可运行 |

| 70B | FP16 | ~140GB | ❌ 超出限制 |

2.3 Radeon 8060S (gfx1151) 的软件支持现状

Radeon 8060S采用gfx1151架构标识,其软件生态支持情况如下:

- ROCm 6.4+:初步支持,部分功能受限

- ROCm 7.1+:官方预览支持,性能显著提升

- Vulkan:通过AMD Adrenalin驱动提供稳定支持

- DirectML:Windows平台备选方案

关键提示:截至2025年Q4,ROCm 7.1是获得最佳性能的必要条件,但Windows用户建议优先使用Vulkan后端以获得更好的稳定性。

3. 推理后端性能对比与选择策略

3.1 三大后端实测数据对比

基于Ryzen AI MAX+ 395(128GB内存)的实测数据(模型:Llama-3.1-8B-Instruct,Q4_K_M量化):

| 推理后端 | Prompt处理速度 | 生成速度 | 内存占用 | 功耗 | 稳定性 |

|---|---|---|---|---|---|

| GPU (ROCm) | 401 tokens/s | 44.6 tokens/s | 中等 | 高 | 中 |

| GPU (Vulkan) | 380 tokens/s | 42.1 tokens/s | 中高 | 中高 | 高 |

| CPU (Zen 5) | 92.6 tokens/s | 17.0 tokens/s | 低 | 中 | 高 |

| NPU (XDNA 2) | 18.2 tokens/s | 10.9 tokens/s | 最低 | 低 | 中 |

3.2 不同场景的最佳选择

graph LR

A[使用场景] --> B{性能需求?}

B -->|追求极致速度| C[GPU + ROCm 7.1<br/>Linux环境]

B -->|平衡性能稳定| D[GPU + Vulkan<br/>Windows/Linux]

B -->|移动办公续航| E[NPU + CPU<br/>混合调度]

A --> F{模型规模?}

F -->|<13B| G[任意后端均可]

F -->|13B-70B| H[GPU必需]

F -->|>70B| I[GPU + 大量内存<br/>推荐Vulkan]3.3 决策矩阵:如何选择推理后端

| 考量因素 | 推荐后端 | 理由 |

|---|---|---|

| Windows系统 + 新手 | Vulkan | 驱动成熟,配置简单 |

| Linux系统 + 开发者 | ROCm 7.1 | 开源生态,性能最优 |

| 笔记本移动办公 | NPU + CPU | 能效比最佳,续航优先 |

| 70B+大模型 | Vulkan | 内存管理更稳定 |

| 生产环境API服务 | ROCm + vLLM | 高并发优化,批处理高效 |

| 快速原型验证 | LM Studio (Vulkan) | 零代码,即开即用 |

4. 主流框架部署实战

4.1 LM Studio:零代码入门方案

4.1.1 适用场景

- 快速体验大模型能力

- 非技术背景用户

- 本地对话助手开发

- 模型对比测试

4.1.2 详细安装步骤

步骤1:系统准备

# Windows PowerShell - 检查Vulkan支持

vulkaninfo --summary

# 输出应包含:

# GPU0: Radeon 8060S (gfx1151)

# driverVersion: 31.0.xxxx (Adrenalin 25.8.1+)步骤2:下载与安装

- 访问官网:https://lmstudio.ai

- 下载Windows版本(v0.3.0+)

- 安装后启动应用

步骤3:GPU配置优化

设置路径:Settings → LLM → GPU Backend

推荐配置:

├─ GPU Backend: Vulkan

├─ GPU Layers: -1 (自动最大化)

├─ Context Length: 8192 (根据内存调整)

├─ Flash Attention: Enabled

└─ Threads: 16 (匹配CPU核心数)步骤4:模型下载与运行

1. 点击左侧搜索图标 🔍

2. 搜索 "Llama-3.1-8B-Instruct-GGUF"

3. 选择量化版本:

- Q4_K_M (推荐平衡点)

- Q5_K_M (更高精度)

- Q3_K_M (节省内存)

4. 下载完成后点击 "Load Model"

5. 开始对话!4.1.3 性能调优技巧

高级设置建议:

- n_batch: 512 # 批处理大小,增大提升吞吐

- n_ctx: 16384 # 上下文窗口,受内存限制

- n_gpu_layers: 999 # 全部层卸载到GPU

- flash_attn: true # 启用Flash Attention加速

- tensor_split: "0" # 单GPU无需分割4.2 llama.cpp:开发者首选工具链

4.2.1 后端选择:Vulkan vs ROCm

方案A:Vulkan后端(跨平台推荐)

# 1. 克隆源码

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp

# 2. 创建构建目录

mkdir build && cd build

# 3. 启用Vulkan编译

cmake .. -DGGML_VULKAN=ON -DCMAKE_BUILD_TYPE=Release

# 4. 编译

cmake --build . --config Release -j16

# 5. 运行推理

./bin/Release/llama-cli.exe \

-m "models/llama-3.1-8b.Q4_K_M.gguf" \

-p "解释量子计算的基本原理" \

-n 512 \

-ngl 999 \

-t 16方案B:ROCm后端(Linux性能最优)

# 前提条件:

# - Ubuntu 22.04/24.04

# - ROCm 7.1+ 已安装

# - 用户加入render和video组

# 1. 使用Docker(推荐简化部署)

docker run --rm -it \

--device=/dev/kfd \

--device=/dev/dri \

--group-add render \

--group-add video \

-v $HOME/models:/models \

rocm/llama.cpp:latest \

./main -m /models/llama-3.1-8b.Q4_K_M.gguf \

-p "Hello" -n 128 -ngl 999

# 2. 或本地编译(需要ROCm环境)

cmake .. \

-DGGML_HIP=ON \

-DAMDGPU_TARGETS="gfx1151" \

-DCMAKE_BUILD_TYPE=Release

make -j164.2.2 高级参数详解

# 完整参数示例

./llama-cli \

-m models/mixtral-8x7b.Q4_K_M.gguf \

-p "用户问题文本" \

-n 2048 \ # 最大生成长度

-ngl 999 \ # GPU层数(-1或999表示全部)

-c 8192 \ # 上下文窗口

-b 512 \ # 批处理大小

-t 16 \ # CPU线程数

--flash-attn \ # 启用Flash Attention

-ctk q8_0 \ # KV缓存量化(节省内存)

-ctv q4_0 \ #

--mlock \ # 锁定内存防止交换

--no-mmap \ # 避免内存映射

--color # 彩色输出4.2.3 批处理与服务器模式

# 启动HTTP API服务

./llama-server \

-m models/llama-3.1-70b.Q4_K_M.gguf \

-ngl 999 \

-c 16384 \

--host 0.0.0.0 \

--port 8080 \

--batch-size 2048 \

--ubatch-size 512 \

--flash-attn

# API调用示例

curl http://localhost:8080/v1/completions \

-H "Content-Type: application/json" \

-d '{

"model": "llama-3.1-70b",

"prompt": "写一篇关于AI的短文",

"max_tokens": 500,

"temperature": 0.7

}'4.3 vLLM:生产级高并发推理

4.3.1 系统要求与限制

⚠️ 重要提示:

- gfx1151在ROCm 7.1+获得预览级支持

- 建议使用预构建Docker镜像

- Windows支持有限,推荐Linux环境

- 需要至少32GB内存(70B模型建议64GB+)

4.3.2 Docker快速部署

# 1. 拉取官方预览镜像

docker pull rocm/vllm-dev:preview7.1_1117_rc1_20251112

# 2. 启动容器

docker run -it --rm \

--network=host \

--device=/dev/kfd \

--device=/dev/dri \

--group-add render \

--group-add video \

--shm-size 64g \

-v $HOME/models:/models \

rocm/vllm-dev:preview7.1_1117_rc1_20251112 \

bash

# 3. 容器内启动vLLM服务

python3 -m vllm.entrypoints.api_server \

--model /models/Llama-3.1-70B-Instruct \

--tensor-parallel-size 1 \

--dtype auto \

--gpu-memory-utilization 0.9 \

--max-model-len 8192 \

--host 0.0.0.0 \

--port 80004.3.3 性能优化配置

# vLLM高级配置示例

from vllm import LLM, SamplingParams

llm = LLM(

model="meta-llama/Llama-3.1-70B-Instruct",

tensor_parallel_size=1, # 单GPU

gpu_memory_utilization=0.95, # 最大化GPU利用率

max_model_len=16384, # 上下文长度

dtype="auto", # 自动选择精度

quantization="awq", # 可选:awq, gptq, fp8

enforce_eager=False, # 使用CUDA Graph加速

max_num_seqs=256, # 最大并发序列

max_num_batched_tokens=8192, # 批处理令牌数

)

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.9,

max_tokens=2048,

)

# 批量推理示例

prompts = ["问题1", "问题2", "问题3"]

outputs = llm.generate(prompts, sampling_params)4.4 Ollama:轻量级命令行方案

4.4.1 快速安装

# Linux/macOS

curl -fsSL https://ollama.com/install.sh | sh

# Windows - 下载安装包

# https://ollama.com/download/windows

# 验证安装

ollama --version4.4.2 运行模型

# 拉取并运行模型

ollama run llama3.2:3b

# 指定GPU后端(环境变量)

export OLLAMA_NUM_GPU=999 # 使用所有GPU层

export OLLAMA_NUM_PARALLEL=4 # 并行请求数

ollama run llama3.1:8b

# 查看硬件加速状态

ollama run llama3.1:8b "/show info"4.4.3 自定义Modelfile

# Modelfile示例 - 创建定制化模型

FROM llama3.1:8b

# 设置系统提示

SYSTEM """你是一个专业的Python编程助手,

擅长解释复杂概念并用简洁代码示例说明。

回答时遵循以下原则:

1. 先给出核心概念解释

2. 提供可运行的代码示例

3. 指出常见陷阱和最佳实践"""

# 调整参数

PARAMETER temperature 0.7

PARAMETER top_p 0.9

PARAMETER num_ctx 8192

# 创建模型

ollama create my-coding-assistant -f Modelfile

# 运行

ollama run my-coding-assistant5. 性能优化与故障排查

5.1 内存管理策略

5.1.1 量化技术对比

| 量化方法 | 精度损失 | 内存节省 | 速度提升 | 推荐场景 |

|---|---|---|---|---|

| Q8_0 | <1% | 50% | 1.2x | 需要高精度的专业应用 |

| Q4_K_M | 2-3% | 75% | 2.0x | 通用推荐 |

| Q4_0 | 3-5% | 75% | 2.2x | 资源受限环境 |

| Q3_K_M | 5-8% | 87.5% | 2.5x | 超大模型(>70B) |

| Q2_K | 10-15% | 93.75% | 3.0x | 极端内存限制 |

5.1.2 KV缓存优化

# 启用KV缓存量化(llama.cpp)

./llama-cli \

-m model.gguf \

-ctk q8_0 \ # Key缓存量化为8位

-ctv q4_0 \ # Value缓存量化为4位

--cache-reuse 256 # 重用前256令牌缓存

# 内存节省效果:

# 8B模型:从12GB降至8GB

# 70B模型:从80GB降至50GB5.2 GPU利用率优化

5.2.1 批处理大小调优

# 批处理性能测试脚本

import time

from llama_cpp import Llama

llm = Llama(

model_path="model.gguf",

n_gpu_layers=-1,

n_ctx=8192

)

batch_sizes = [64, 128, 256, 512, 1024, 2048]

prompts = ["测试问题"] * 100

for batch_size in batch_sizes:

start = time.time()

llm.create_completion(

prompt=prompts[0],

max_tokens=100,

batch_size=batch_size

)

elapsed = time.time() - start

print(f"Batch {batch_size}: {elapsed:.2f}s")

# 典型结果(Ryzen AI MAX+ 395):

# Batch 64: 12.5s

# Batch 256: 8.3s ← 最佳平衡点

# Batch 1024: 9.1s ← 内存压力增加

# Batch 2048: OOM ← 内存不足5.2.2 Flash Attention加速

# 启用Flash Attention(需模型支持)

./llama-cli \

-m model.gguf \

--flash-attn \

-fa_scale 1.0

# 性能提升:

# - 长上下文(>4K):速度提升40-60%

# - 内存占用:减少20-30%

# - 注意:短文本(<1K)可能无明显提升5.3 常见问题排查

5.3.1 GPU未被识别

# 问题:llama.cpp显示"using CPU only"

# 解决方案1:检查Vulkan支持

vulkaninfo --summary

# 应看到:GPU0: Radeon 8060S

# 解决方案2:检查ROCm识别(Linux)

rocminfo | grep gfx1151

# 无输出?更新ROCm驱动

# 解决方案3:显式指定GPU层数

./llama-cli -m model.gguf -ngl 999

# 而非依赖自动检测5.3.2 内存不足(OOM)

# 错误:ggml_backend_buffer_alloc: failed to allocate buffer

# 诊断步骤:

# 1. 检查系统内存

free -h # Linux

# 或

Task Manager → Performance → Memory # Windows

# 2. 降低上下文长度

-ctk q8_0 -ctv q4_0 # KV缓存量化

-c 4096 # 减小上下文窗口(默认可能8192+)

# 3. 使用更低量化

# Q4_K_M → Q3_K_M → Q2_K

# 4. 关闭内存映射

--no-mmap # 避免虚拟内存过度占用5.3.3 ROCm兼容性问题

# 问题:vLLM启动失败,报错"unsupported device"

# 检查ROCm版本

rocminfo | grep "HSA Agent"

# 需要ROCm 7.1+

# 临时方案:使用Vulkan后端

# 或等待ROCm 7.2正式支持gfx1151

# 验证gfx1151支持

grep -r "gfx1151" /opt/rocm/

# 无结果?当前ROCm版本不支持6. 实战案例:构建本地AI助手

6.1 场景一:隐私优先的代码助手

需求:在不联网的情况下,为开发团队提供代码审查和重构建议。

方案架构:

graph TB

A[VS Code插件] --> B[本地API服务器]

B --> C[llama.cpp Server]

C --> D[Llama-3.1-70B-Code]

D --> E[128GB统一内存]

style E fill:#90EE90

style D fill:#87CEEB部署脚本:

#!/bin/bash

# 启动代码助手服务

MODEL="deepseek-coder-33b.Q4_K_M.gguf"

PORT=8080

# 启动后台服务

nohup ./llama-server \

-m models/$MODEL \

-ngl 999 \

-c 16384 \

--host 127.0.0.1 \

--port $PORT \

--batch-size 1024 \

--flash-attn \

--log-disable \

> /dev/null 2>&1 &

echo "代码助手已启动:http://localhost:$PORT"

echo "PID: $!"

# VS Code设置(settings.json)

{

"continue.continueServerUrl": "http://localhost:8080",

"continue.models": [{

"title": "Local Code Assistant",

"provider": "ollama",

"model": "deepseek-coder-33b"

}]

}6.2 场景二:企业知识库问答系统

需求:基于公司内部文档构建RAG(检索增强生成)系统。

技术栈:

- 嵌入模型:nomic-embed-text-v1.5(本地运行)

- 向量数据库:ChromaDB

- 大模型:Llama-3.1-70B-Instruct(Q4_K_M)

- 框架:LangChain + llama.cpp

核心代码:

from langchain_community.embeddings import HuggingFaceEmbeddings

from langchain_community.vectorstores import Chroma

from langchain_community.llms import LlamaCpp

from langchain.chains import RetrievalQA

# 1. 加载嵌入模型(CPU运行即可)

embeddings = HuggingFaceEmbeddings(

model_name="nomic-ai/nomic-embed-text-v1.5",

model_kwargs={'trust_remote_code': True}

)

# 2. 构建向量数据库

vectorstore = Chroma(

persist_directory="./chroma_db",

embedding_function=embeddings

)

# 3. 配置大模型(GPU加速)

llm = LlamaCpp(

model_path="models/llama-3.1-70b.Q4_K_M.gguf",

n_gpu_layers=-1,

n_ctx=8192,

n_batch=512,

temperature=0.1, # 降低温度提高准确性

top_p=0.9,

verbose=False

)

# 4. 创建RAG链

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=vectorstore.as_retriever(

search_kwargs={"k": 5} # 检索top-5文档

),

return_source_documents=True

)

# 5. 查询示例

query = "公司差旅报销政策是什么?"

result = qa_chain.invoke({"query": query})

print(f"答案:{result['result']}")

print(f"来源:{result['source_documents'][0].metadata['source']}")性能优化:

# 启用缓存加速重复查询

from functools import lru_cache

@lru_cache(maxsize=1000)

def cached_query(question: str) -> str:

return qa_chain.invoke({"query": question})['result']

# 批处理文档嵌入

from langchain.text_splitter import RecursiveCharacterTextSplitter

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=1000,

chunk_overlap=200

)

# 批量处理1000+文档

documents = text_splitter.split_documents(all_docs)

vectorstore.add_documents(documents, batch_size=100)6.3 场景三:多模态AI工作站

需求:同时运行文本生成、图像生成、语音识别等多个AI任务。

资源分配策略:

# 系统资源分配方案(128GB内存)

任务分配:

文本推理 (Llama-3.1-70B):

内存: 48GB

GPU层数: 全部 (999)

后端: Vulkan

图像生成 (Stable Diffusion XL):

内存: 16GB

GPU: 共享(动态分配)

后端: DirectML / ROCm

语音识别 (Whisper Large):

内存: 6GB

GPU层数: 部分 (35/39)

后端: CUDA / ROCm

系统预留:

内存: 58GB

用途: 操作系统、多任务切换、缓存

调度策略:

- 优先级: 文本推理 > 语音识别 > 图像生成

- 使用systemd或Docker Compose管理资源

- 启用swap作为应急(SSD swap,非HDD)7. 未来展望与生态发展

7.1 AMD ROCm生态路线图

根据AMD官方披露的信息:

| 时间节点 | ROCm版本 | gfx1151支持级别 | 关键特性 |

|---|---|---|---|

| 2024 Q4 | 6.4 | 实验性 | 基础推理支持 |

| 2025 Q2 | 7.1 | 预览版 | 性能优化,vLLM支持 |

| 2025 Q4 | 7.2 | 正式版 | 生产环境认证 |

| 2026 Q2 | 7.3+ | 完全优化 | Flash Attention 3, FP8 |

7.2 统一内存架构的未来

随着AMD Strix Halo架构的成功,未来趋势包括:

- 更大容量统一内存:256GB LPDDR6成为可能

- NPU性能跃升:100+ TOPS,支持更大模型

- 硬件级虚拟化:多用户共享GPU资源

- 标准化API:统一Vulkan/ROCm/DirectML接口

7.3 对开发者的建议

短期行动(2025年):

✓ 掌握llama.cpp + Vulkan部署方案

✓ 学习GGUF量化格式和模型转换

✓ 构建本地RAG应用原型

中期规划(2025-2026):

→ 迁移到ROCm 7.2+获得最佳性能

→ 探索NPU加速的特定工作负载

→ 参与AMD ROCm开源社区贡献

长期布局(2026+):

◆ 关注AMD MI300系列与Strix Halo的协同

◆ 研究混合精度推理(FP8/INT4)

◆ 构建跨平台AI应用(AMD + NVIDIA兼容)8. 总结

AMD Ryzen AI MAX+ 395 + Radeon 8060S组合为本地大模型推理提供了前所未有的可能性。通过本文的学习,您应该能够:

✅ 理解硬件架构:掌握CPU/GPU/NPU三位一体的异构计算原理

✅ 选择合适框架:根据场景在LM Studio、llama.cpp、vLLM中做出明智选择

✅ 优化性能:运用量化、批处理、KV缓存等技术提升推理速度

✅ 解决实际问题:排查GPU识别、内存不足等常见故障

✅ 构建生产系统:部署代码助手、知识库问答等企业级应用

核心要点回顾:

- Vulkan是Windows用户的首选,稳定性优于ROCm

- ROCm 7.1+是Linux用户的性能利器,但需等待正式支持

- Q4_K_M量化是最佳平衡点,精度损失<3%,速度提升2倍

- 128GB统一内存是最大优势,可运行70B+模型

- NPU适合低功耗场景,而非追求峰值性能

随着AMD ROCm生态的成熟,Strix Halo架构有望成为移动AI工作站的新标准。现在正是掌握这一技术的最佳时机!

参考文献与资源

- AMD官方博客:Ryzen AI MAX+ 395技术详解

https://www.amd.com/en/blogs/2025/amd-ryzen-ai-max-upgraded-run-up-to-128-billion-parameter-llms-lm-studio.html - llama.cpp官方文档

https://github.com/ggerganov/llama.cpp - ROCm兼容性矩阵

https://rocm.docs.amd.com/en/latest/compatibility/compatibility-matrix.html - LM Studio使用指南

https://lmstudio.ai/docs

如果您觉得本文有帮助,欢迎分享和讨论!您在Ryzen AI MAX+ 395上的部署经验是什么?遇到了哪些挑战?欢迎在评论区交流。